NovelAI V4モデルの初期成果をお見せした後、できるだけ早く皆様の手元にお届けしたいと考えました。この度、NovelAI Diffusion V4 — Curated Previewのリリースを発表できることを大変喜ばしく思います。

これはプレビュー版であることをご了承ください。通常のモデルで利用できる機能の多くがまだ実装されていない状態です!フル機能版の提供に向けて鋭意取り組んでおりますが、それまでの間はこのプレビュー版をお楽しみいただければと思います! このリリースに含まれる機能と含まれない機能について、以下で詳しくご説明します。

V4は、Stable Diffusionなどのパブリックベースモデルに依存せず、完全に一から学習を行った、NovelAI初の完全オリジナルの画像生成モデルファミリーです。モデルが完全に異なるため、プロンプトの解釈もV3モデルとは違ってきます。そのため、これまでお使いのプロンプトは調整が必要になるかもしれません。

複数キャラクターを含む画像の生成を完全にサポートし、英語の自然言語の理解が向上し、イメージした通りのシーンへの英語テキストの描画能力も改善されるなど、多くの新機能が加わりました。さらに、細部の表現力向上、創造性の改善、大幅に拡張・更新された知識ベース、そして大きく拡充されたデータセットを実現しています。

画像生成モデルV1の時代と同様に、今回2つの異なるバージョンのモデルをリリースします。1つ目は、ホリデーシーズン前に新機能を体験していただくため、プレビュー段階で現在リリースしているCurated版です。Curatedモデルはデータの一部のみで訓練されており、配信中や公共の場、友人との使用に適しています。見事な画像で驚かせることは間違いありませんが、知識は限定的です。完全なデータセットで訓練され、現行モデルが扱える多様なトピックすべてに対応するFullモデルは、現在も学習中です。多くの方々がFullモデルのリリースを特に楽しみにされていることと思いますが、もう少し熟成が必要です。この待ち時間は必ず価値あるものになると確信しています!

現在学習中のFullモデルと共に、現行のプレビュー版では他の重要な機能もまだ使用できない状態です。バイブトランスファーは新モデル用に一から再学習する必要があるため、まだ利用

できません。インペイントも同様ですが、こちらは古いV3バージョンにフォールバックするため、新しいV4の機能は使えないものの、引き続き画像のインペイントは可能です。

これらの機能は、来年初めにリリース予定のFullモデルと共に提供される予定です。また、SMEAとSMEA Dynサンプラーも現時点では利用できませんが、近い将来提供できるよう準備を進めています。DDIMも現在利用できません。Curatedモデル自体も、Fullモデルのリリースに合わせて、もしくは今後数日以内に更新する可能性があります。

制限について説明してきましたが、次はV4が提供する新しいツールについて詳しく見ていきましょう。

V4の新機能

ここでは、V4で新たに使えるようになった機能と、再び利用可能となった機能について詳しく説明します。

マルチキャラクタープロンプト

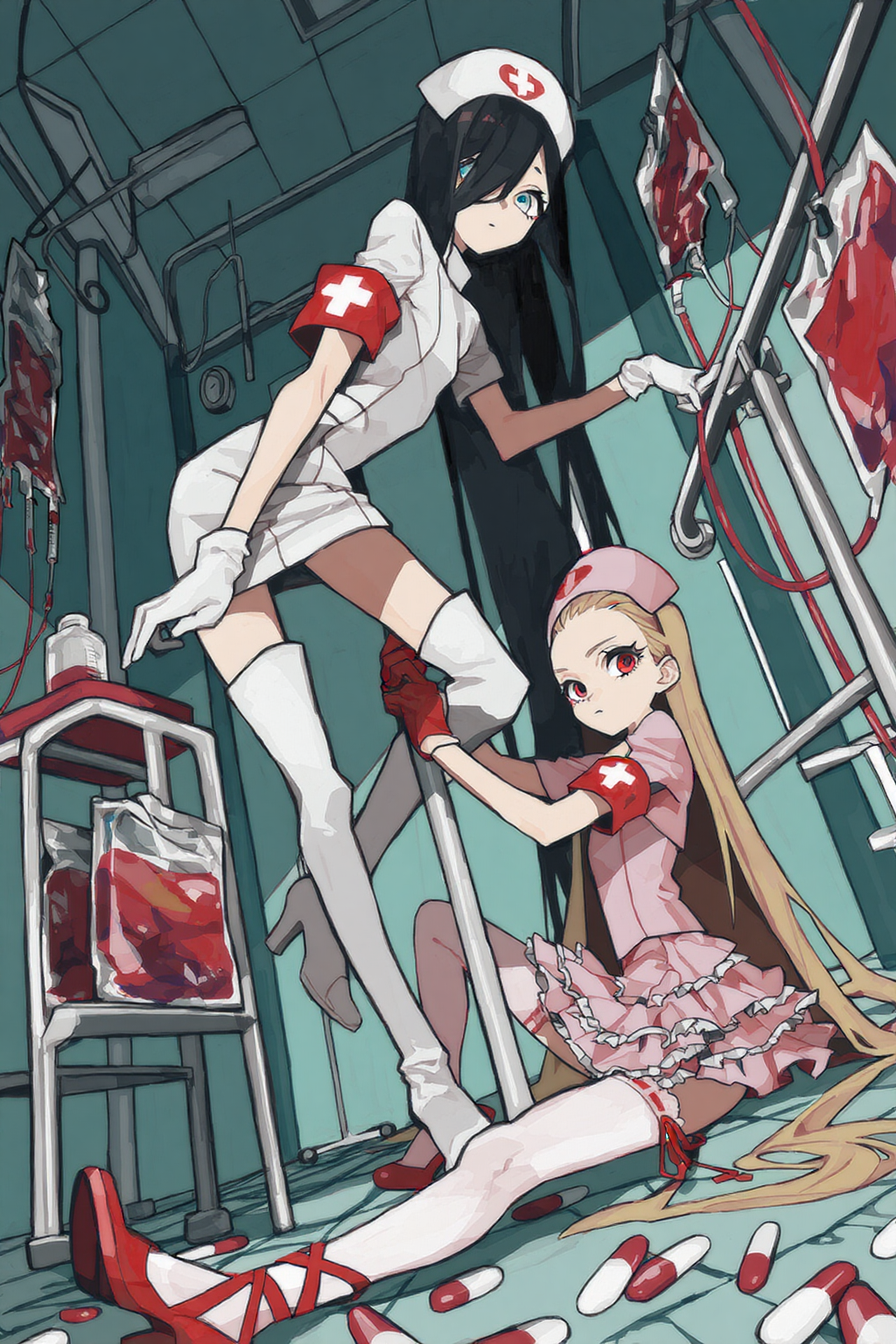

V4の最も強力な新機能の1つが、最大6人のキャラクターを1枚の画像内で個別に指定できる機能です。キャラクター間での情報の混ざり合いが最小限に抑えられ、複数のキャラクターが相互に関わり合うような複雑なシーンの作成が、よりスムーズになりました。特にオリジナルキャラクターを含む画像では、この新機能が大きな威力を発揮します。

この機能は、プロンプトをベースプロンプトと複数のキャラクタープロンプトに分けることで実現しています。ベースプロンプトではシーンや画像の絵柄などを決定し、キャラクタープロンプトでは各キャラクターの特徴を他のキャラクターと独立して記述することができ、情報の混ざり合いを最小限に抑えます。

マルチキャラクタープロンプトには2つの使用方法があります。1つ目は推奨される方法で、プロンプトボックスの下にある「+ キャラクターを追加」ボタンをクリックします。これにより、そのキャラクター専用の新しいプロンプトボックスが追加されます。ボックスをクリックすると、そのキャラクター特有のプロンプトを入力できます。他のプロンプトから情報が混ざり込んでしまったり、意図しない要素が生成されたりした場合は、ベースプロンプトと同様に、各キャラクターの除外したい要素欄を使用して、それらの要素を抑制することができます。

マルチキャラクタープロンプトを使用する際、通常モデルはキャラクタープロンプトが並んでいる順序に従って、上から下、左から右の配置で画像内に配置します。例えば、2人のキャラクターがいて「side-by-side」タグを使用した場合、1つ目のプロンプトボックスのキャラクターは通常画像の左側に、2つ目のキャラクターは右側に配置されます。各キャラクタープロンプトボックスの右上にある上下の矢印を使えば、キャラクターの順序を素早く変更できます。

さらに、キャラクターを画像内のどの位置に配置したいかを(おおよそですが)指定する方法もあります。これは少し高度な機能で、モデルへの軽いヒント程度のものです。そのため、設定する位置がキャラクタープロンプトボックスの順序と矛盾せず、自然な言語によるプロンプトでも補強されているのが望ましいです。この機能を使用するには、最低2つのキャラクタープロンプトボックスが必要です。キャラクタープロンプトボックスの下にある「AIにおまかせ」のトグルを無効にすると、キャラクタープロンプトボックスをクリックした際に「位置」ボタンが表示されます。このボタンをクリックすると5×5のグリッドが表示され、グリッド内の任意のセルをクリックして「完了」を押すことで、キャラクターのおおよその位置を設定できます。

また、キャラクター数を示すタグ(Xboys、Ygirls、Zothersなど)についても注意が必要です。これらのタグは必ずベースプロンプト部分に入れ(例:「2girls, 2boys, outdoors, …」)、各キャラクタープロンプトでは数を指定せずに「girl」「boy」「other」のみを指定します(例:「girl, purple hair, …」や「boy, blonde hair, …」)。これにより、モデルはそのキャラクタープロンプトで記述されているキャラクターをどのように描くべきかを理解します。

手早く試してみたい場合で、ボタンをクリックするのが面倒な時は、プロンプト内で「|」記号を使用してベースプロンプトとキャラクタープロンプトを区切ることもできます。V4ではプロンプトミキシングは利用できないため、代わりにこの「|」記号がこの目的で使用されます。ただし、「|」記号による記法とキャラクタープロンプトボックスを併用することはできません。キャラクタープロンプトボックスが1つでも存在する場合、「|」記号による記法は無効になります。この記法を使用したプロンプトの例は以下のようになります:

2girls, indoors, factory, night, fog, industrial lights, pipes, light particles, cardboard box, aesthetic, best quality, english text, text | girl, purple eyes, short hair, smile, open mouth, ruffled blouse, red blouse, pleated skirt, blonde hair, green scarf, hands on own hips, blunt bangs, blue skirt, medium skirt, small breasts, bob cut, target#pointing, long sleeves, red nails, fang, cowboy shot. She is being pointed at. | girl, very long hair, purple hair, curly hair, white jeans, white pants, golden shirt, cowboy shot, green eyes, turtleneck sweater, sleeveless turtleneck, side braid, medium breasts, sleeveless, ripped jeans, wavy mouth, blush, purple nails, open mouth, source#pointing at another, speech bubble. She is pointing at the other girl and scolding her. Text: Stop that!

アクションタグ

キャラクタープロンプトにおけるアクションタグをより明確に指定するため、新しい特殊な記法を追加しました。複数のキャラクターが相互に関わり合う場合、アクションタグの記法を使用することで、「source#」「target#」「mutual#」の接頭辞をつけることにより、そのアクションの主体と対象を指定できます。例えば、あるキャラクターが別のキャラクターを抱きしめる場合、抱きしめる側のキャラクターには「source#hug」タグを、抱きしめられる側のキャラクターには「target#hug」タグを指定します。お互いに抱きしめ合う場合は、両方のキャラクターに「mutual#hug」タグを使用できます。

この記法は必ずしも確実に機能するわけではありませんが、多くの場合で有用です。

英語の自然言語理解

タグだけでは表現が難しい場合が多くあります。新しいV4モデルは英語の自然言語による説明を理解できるため、望む結果をより簡単に指定できるようになりました。

例:

1girl, sundress, looking at viewer, full body. There are three objects. A single red cube. A single blue cube is placed on top of the red cube. A single green sphere lies to the left of the red cube, just next to it. The girl is standing to the right, next to the red cube. Digital illustration. Highly finished. Still life. Character Study.

重要な注意点として、このモデルでは以前と異なり、大文字と小文字、およびスペースを区別するようになりました。タグ内でアンダーバー(_)を使用せず(顔文字の「^_^」などは除く)、全てのタグを小文字で記述し、カンマとスペース(”, “)で区切ることを強く推奨します。自然言語による説明は、英語の文法、スペル、大文字小文字の規則に従って記述してください。

長いプロンプトが使用可能に

ベースプロンプトと全てのキャラクタープロンプトを合わせて、最大約512個のT5トークンまで使用できるようになりました。これまでになく多くのアイデアを表現できる余地が生まれています。

ただし、T5トークナイザーを使用しているため、プロンプトの一部としてほとんどのUnicode文字(カラー絵文字や日本語文字など)はモデルでサポートされていないことにご注意ください。

16チャンネルVAE

少し専門的に聞こえるかもしれませんが、これまでのモデルはすべて4チャンネルの変分オートエンコーダー(VAE)を使用していました。VAEの目的は、RGBピクセルの画像をモデルの「言語」に変換し、また元に戻すことです。チャンネル数は基本的に、モデルが認識し、学習し、そして描画できる細部の精細さを決定します。16チャンネルVAEにアップグレードすることで、細部の表現力が向上し、目の細部や装飾品、テキストなど、多くの要素が改善されます。具体的には、Apache 2.0ライセンスの16チャンネルFLUX VAEを使用しています。

テキスト

V4は小説のような長文を画像に描くことはできませんが、V3モデルと比べて、より判読可能な英語テキストを生成できます。テキストを指定する最適な方法は、プロンプトに「text, english text」のタグを含め、その後にピリオドを打ち、続けて「Text:」と画像に表示したい文章を入力することです。

モデルがスペルに苦労している場合は、テキストを全て大文字にすることで改善する場合があります。テキストを特定の位置に配置したい場合は、タグで明確に示されていない限り(吹き出しなど)、英語の自然言語で場所を説明することができます。キャラクターにセリフを言わせたい場合は、ベースプロンプトではなくキャラクタープロンプトボックスに「Text:」を入れることもできます。モデルに対して繰り返し指定すると効果的な場合もあります。これらを組み合わせた例を以下に示します:

1girl, text, english text, speech bubble, white background. A pastel pink speech bubble with yellow handwritten text says “HAVE FUN!”. Text: HAVE FUN!

特殊タグと年代のタグ

これまでのモデルと同様に、美的タグ、クオリティ、年代のタグを使用できます。

- クオリティタグ:best quality, amazing quality, great quality, normal quality, bad quality, worst quality

- 美的タグ:very aesthetic, aesthetic, displeasing, very displeasing

- 年代タグ:year 2024や他の年を指定することで、その年代に多く見られた絵柄に近いスタイルで画像を生成します。

Image2Image

画像生成モデルの定番機能であるImage2Imageは、このプレビュー版でも、もちろん利用可能です。

新しい特殊タグとフレーズ

興味深い効果を生み出す新しいタグも追加されています。以下は完全なリストではありませんが、始めるのに十分な例を紹介します。

- Character Studyは、シーン内のキャラクターにより焦点を当てるために使用できます。画像が引きすぎている場合に効果的です。さらに、「the characters are the central focus of this image」のようなフレーズを追加すると、より効果を高めることができます。

- 特殊なタグの組み合わせとタグ:

- 「photo (medium), photographic doll, fumo (doll)」でふもスタイルのぬいぐるみを生成します。

- 「photo (medium), figure」でフィギュア形式のキャラクターを生成します。

- 「artist:ainiwaffles」でAiniさんの絵柄の画像を生成します。テキスト生成モデルのキャラクター擬人化をご存知の方には馴染みのある絵柄になります。

英語の自然言語を使用して、画像の絵柄にも影響を与えることができます。以下のような言い回しを自然な英文で試してみて、言葉を調整することで好みに合わせることができます:

- 「highly finished」は、画像が未完成な部分がなく、線がクリーンで、陰影が完全に仕上がっていることを示します。

- 「Digital illustration」を使うと、場合によって生成される画像の品質が全体的に向上し、よりイラスト寄りの絵柄になります。

- 「Anime style」を使うと、より明確にアニメ調の絵柄に寄せることができ、場合によって有用です。

- 「smooth shading」は、セル調ではないなめらかな陰影表現を示します。

- 「smooth, shiny shading」は、さらに光沢のあるハイライトを強調します。

- これらを組み合わせて次のような文章にしてみましょう:「The image is a highly finished digital illustration in anime style with smooth, shiny shading.」

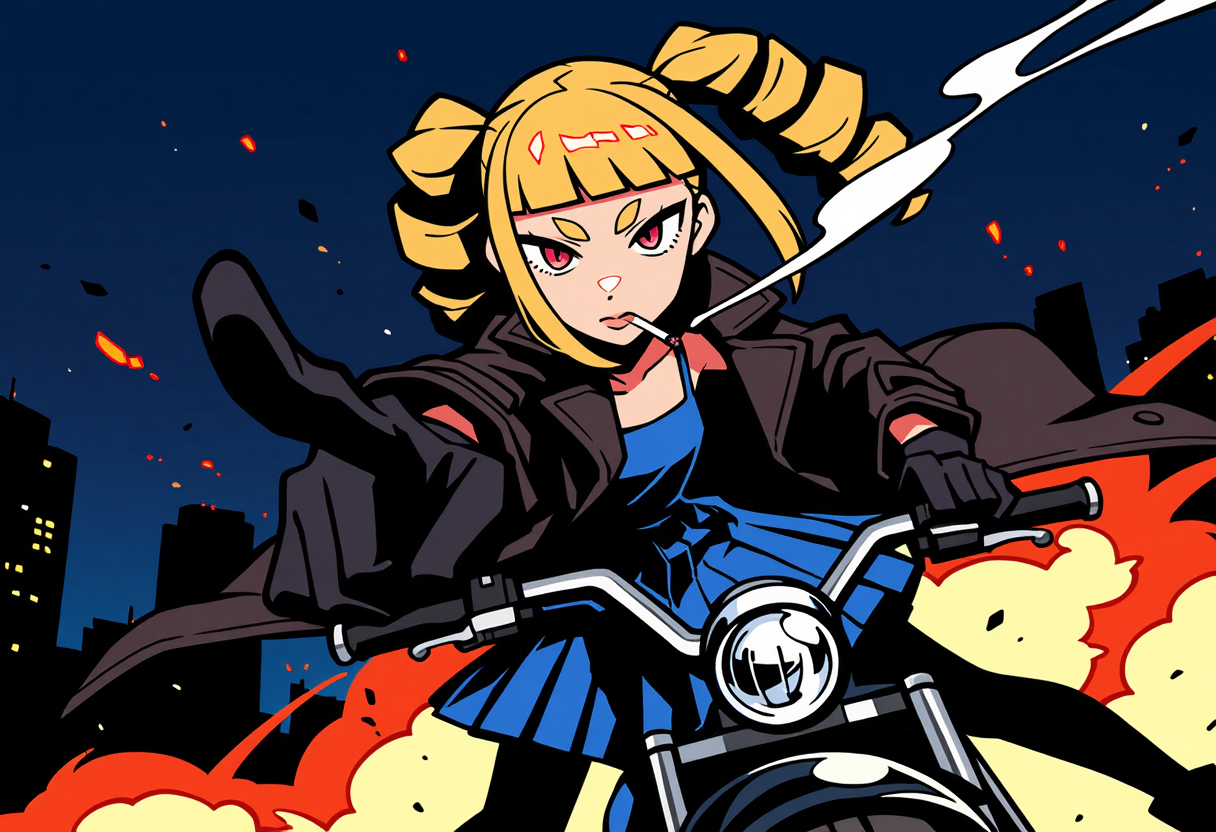

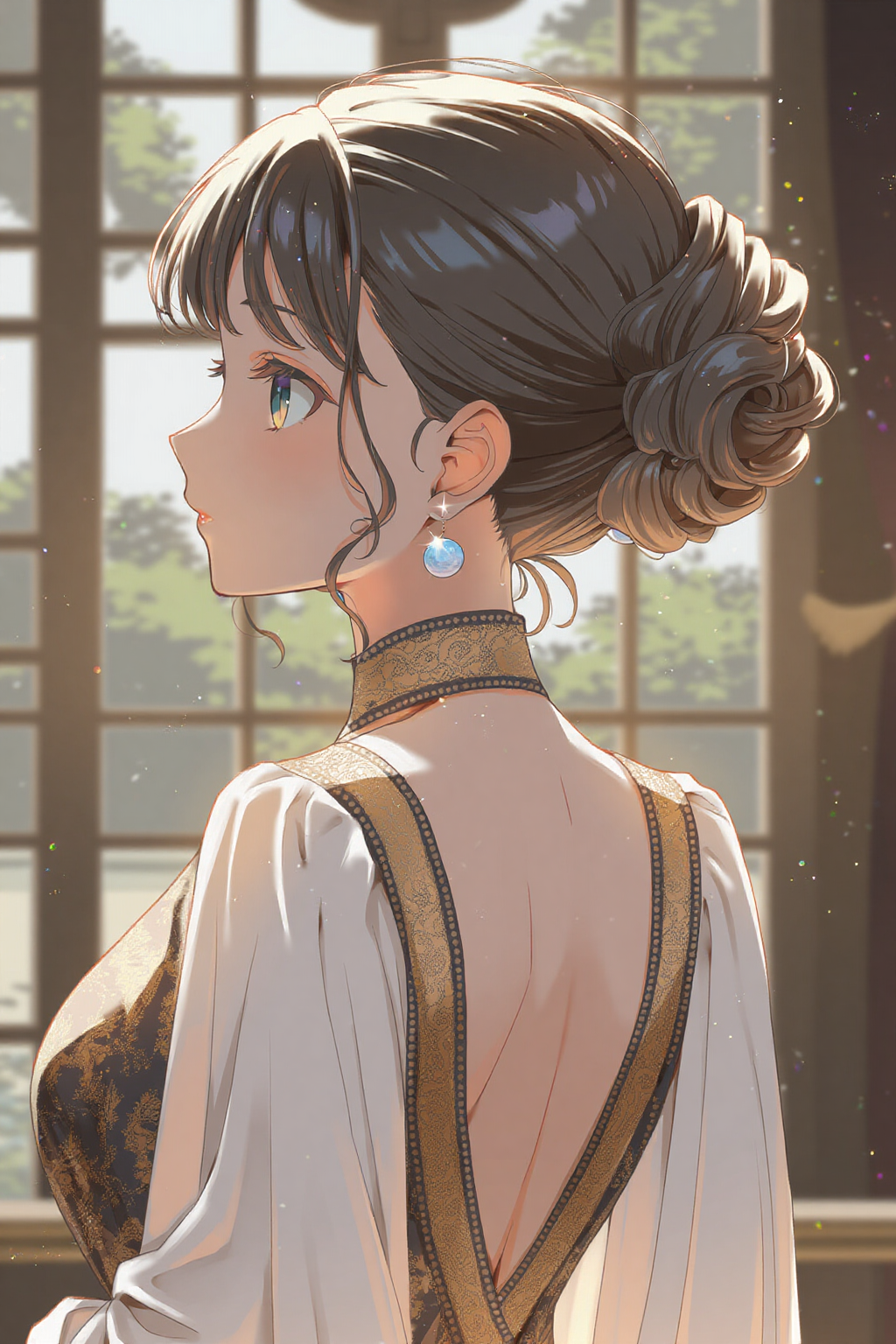

作品ギャラリー

素晴らしい作品の数々をご覧ください!優れたテスターコミュニティとAnlatanメンバーがNovelAI V4 Curated Previewの実力を試してきました。ご覧の通り、素晴らしい結果が得られています!皆様の創造性に感動しています!

以上です!

皆様がV4プレビュー版での画像生成を私たちと同じように楽しんでいただけることを願っています。皆様の素晴らしい作品の投稿をお待ちしています。

ぜひXなどのSNSで #NovelAI や #NAIV4 のハッシュタグをつけて作品を共有してください。